Чем опасна недостоверная информация в сети?

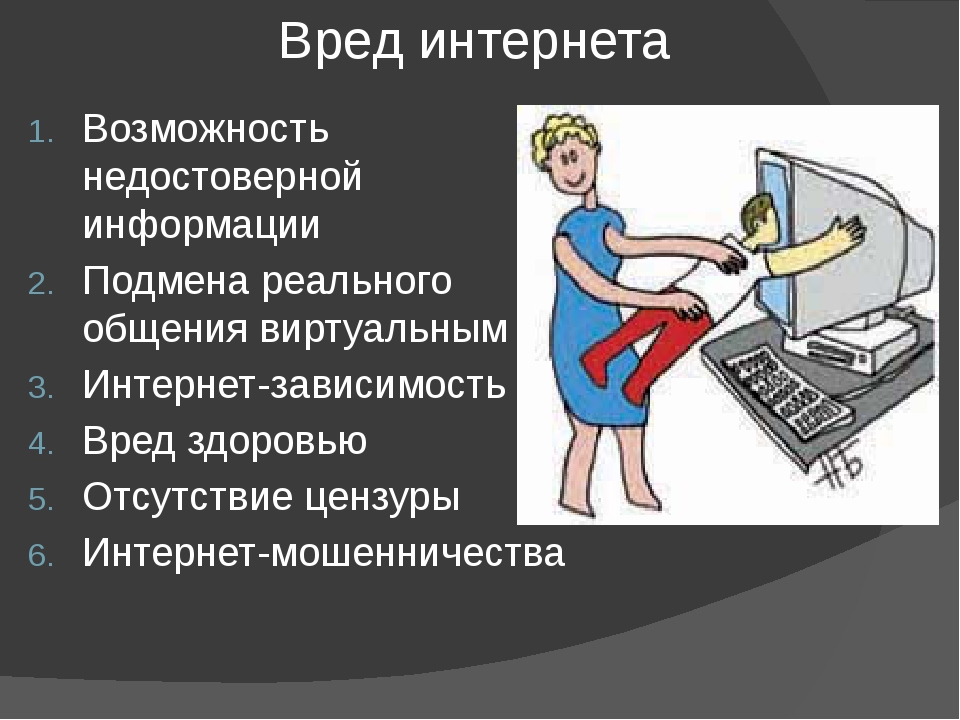

В последние годы Интернет стал самым популярным источником информации. Это вполне закономерно, поскольку поиск данных в Сети удобен, прост и занимает гораздо меньше времени, чем поход в библиотеку, чтение архивов газет или даже просмотр телевизора. В связи с постоянным развитием Интернет-технологий, в обществе сформировалось позитивное общественное мнение о полезности Интернета, а расширение его технических возможностей и аудитории, повлекло за собой появление множества информационных сервисов и ресурсов. Поиск информации через Интернет стал прерогативой не только рядовых пользователей, но и государственных служащих, бизнесменов и коммерческих организаций. Ведь своевременное получение информации способно приносить немалую прибыль и ощутимую пользу. Коммуникация с клиентами и потребителями, доступная реклама перед потенциальной аудиторией, все это открыло массу возможностей как для потребителей, так и для распространителей информации.

Доверяй, но проверяй

Таким образом, рано или поздно перед каждым пользователем Интернета встает один неизбежный вопрос. Можно ли доверять той информации, которая публикуется в Интернете? Осуществлять контроль достоверности информации, полученной в результате поиска, не только можно, но и нужно. Доверять всему, что написано в Сети было бы слишком глупо и наивно, ведь Интернет является зоной свободного доступа, и абсолютно каждый может принимать участие в его наполнении. Рассмотрим традиционные способы проверки полученных через Интернет данных:

1. Проверка фактического материала

Факт выдумать невозможно, ибо его достоверность строго установлена. Любые фактические и статистические данные имеют источник. Проверка точности фактов и приведенных чисел с большой долей вероятности покажет, на какие данные опирается сайт. Идеальным будет наличие ссылок на авторитетные источники вроде агентств сбора статистики или научные институты. Если эта информация не является точной или не соответствует действительности, то и остальной материал также не будет заслуживать доверия.

2. Поиск других источников информации

Сравнение – один из самых эффективных способов поиска истины. Редко одна и та же недостоверная информация публикуется на нескольких сайтах сразу. Поэтому, если одни и те же данные встречаются в Интернете на совершенно разных ресурсах, то им можно доверять. При этом стоит уделить внимание первоначальному источнику информации. К сожалению, не редки случаи, когда все сайты ссылаются на один и тот же недостоверный источник.

3. Установление использования материала другими источниками

Перепечатка и копирование данных с одного сайтам другими сайтами является хорошим знаком, поскольку это означает, что этому источнику доверяют. Чем больше ссылок на исходный материал мы найдем в Интернете, тем выше его авторитет в глазах других ресурсов. Несомненно, это говорит в пользу приведенной информации.

4. Выяснение рейтинга и авторитета сайта

Самый простой и действенный способ убедится в правдивости полученной информации, это ознакомится с репутацией сайта, на котором она размещена. Известные ресурсы обычно заслуживают доверия, поскольку трепетно относятся к своему рейтингу и не станут разменивать его на сомнительные сенсации. Узнать о популярности сайта можно с помощью специальных рейтинговых систем, например через топ «Рамблера» и «Яндекса». Также можно просто вбить название ресурса в любой поисковик и почитать отзывы о нем. Хорошим знаком является наличие у ресурса свидетельства о регистрации СМИ. Онлайн-СМИ несут особую ответственность за любую опубликованную информацию, поэтому стараются избегать непроверенных данных. Кроме того, проверенные данные публикуют официальные сайты, являющиеся первоисточниками.

Известные ресурсы обычно заслуживают доверия, поскольку трепетно относятся к своему рейтингу и не станут разменивать его на сомнительные сенсации. Узнать о популярности сайта можно с помощью специальных рейтинговых систем, например через топ «Рамблера» и «Яндекса». Также можно просто вбить название ресурса в любой поисковик и почитать отзывы о нем. Хорошим знаком является наличие у ресурса свидетельства о регистрации СМИ. Онлайн-СМИ несут особую ответственность за любую опубликованную информацию, поэтому стараются избегать непроверенных данных. Кроме того, проверенные данные публикуют официальные сайты, являющиеся первоисточниками.

5. Получение информации об авторе материала

Для того чтобы понять, стоит ли доверять какой-либо статье, можно поискать информацию о статусе и компетентности ее автора. Не лишним будет ознакомиться с другими его работами, комментариями и отзывами читателей. Если автор статьи имеет хороший журналистский опыт, почетную должность или научную степень, шансы на правдивость его доводов прилично возрастают. Кроме того, в Интернете могут быть его блоги, страницы социальной сети и прочая информация, которая поможет составить мнение об авторе.

Кроме того, в Интернете могут быть его блоги, страницы социальной сети и прочая информация, которая поможет составить мнение об авторе.

Поиск – это серьезно

Не менее важен грамотный подход к самому процессу поиска информации. Редкий пользователь точно знает сайты, на которых может получить интересующие его данные. Подавляющее большинство людей использует популярные поисковые сервисы, такие как Google, Yandex, Rambler и Mail. Очень многое зависит от поисковой процедуры и формулировки запроса. Любая поисковая система ищет в своей базе данных из миллиарда страниц те, что соответствуют заданным параметрам. Для этого используется так называемая программа индексации. Она распознает текст, связи, и другое содержание страницы, и хранит это в файлах базы данных так, чтобы страница могла быть найдена по ключевым словам. После того, как пользователь делает поисковый запрос, машина ищет нужное слово в своем индексе. Если бы система искала по всему Интернету, то на ответ ей понадобилось бы несколько дней. Поскольку поиск ведется в индексе, многие результаты могут быть устаревшими. Всем известен пример, когда страница уже не существует, а поисковик все еще ее находит и восстанавливает. При этом многие свежие сайты в поисковый результат не попадают. Поэтому если мы не может найти что-либо в одной поисковой системе, имеет смысл поискать в другой.

Поскольку поиск ведется в индексе, многие результаты могут быть устаревшими. Всем известен пример, когда страница уже не существует, а поисковик все еще ее находит и восстанавливает. При этом многие свежие сайты в поисковый результат не попадают. Поэтому если мы не может найти что-либо в одной поисковой системе, имеет смысл поискать в другой.

Подытоживая, можно сделать следующие выводы. Необходимо четко представлять себе, что мы ищем. Правильно сформулированный запрос сэкономит много времени и усилий, а также позволит найти именно то, что нужно. Стоит доверять официальным сайтам и их пресс-релизам. Также заслуживают доверия информационные агентства, научные институты и их исследования. За опубликованные данные несут ответственность онлайн-СМИ. Отдельную категорию составляют материалы, перепечатанные из реальных источников, но доступные в Интернете. Например, учебники и энциклопедические данные. При этом нужно настороженно относиться к таким ресурсам, как Википедия. Информация, опубликованная в ней, вполне может оказаться недостоверной, поскольку доступ к редактированию статей имеет любой желающий. Это может быть, как опытный профессор, так и обыкновенный школьник. Википедия хороша для расширения кругозора, однако ссылаться на нее в серьезной работе весьма опасно. Тоже самое можно сказать и о блогах. Блоггеры, которых называют «гражданскими журналистами», порой располагают очень интересной информацией, которую нельзя найти даже в СМИ. Но при этом часто никто кроме автора блога не может подтвердить достоверность опубликованной информации. Поэтому использовать блоггерские данные нужно осторожно, проверяя их особенно тщательно. Конечно, речь не идет о президентском блоге или «официальных» блогах компаний.

Это может быть, как опытный профессор, так и обыкновенный школьник. Википедия хороша для расширения кругозора, однако ссылаться на нее в серьезной работе весьма опасно. Тоже самое можно сказать и о блогах. Блоггеры, которых называют «гражданскими журналистами», порой располагают очень интересной информацией, которую нельзя найти даже в СМИ. Но при этом часто никто кроме автора блога не может подтвердить достоверность опубликованной информации. Поэтому использовать блоггерские данные нужно осторожно, проверяя их особенно тщательно. Конечно, речь не идет о президентском блоге или «официальных» блогах компаний.

Руководствуясь правилами элементарной логики, подготовленный пользователь сумеет отличить правду от лжи. Однако даже самый искушенный человек может оказаться обманутым. Засилье многочисленных красиво оформленных сайтов мошенников и желтой прессы способно ввести в заблуждение кого угодно. Крайне важно проверять все важные данные, найденные в Интернете, поскольку последствия использования недостоверной информации могут быть весьма печальными.

Что угрожает студентам в интернете?

Кафедра социологии МГИМО представила результаты исследования «Виртуальная свобода и безопасность студентов в интернете». Ученые изучали проблемы использования интернета с учетом гендерных, возрастных, социокультурных факторов, защищенности студентов в интернете, осознания ими правовых и этических границ виртуального общения, а также ответственности за распространение недостоверной информации. Мы задали несколько вопросов руководителю проекта заведующему кафедрой социологии С.Кравченко.

Прежде всего, хотелось бы узнать, кто, собственно, был объектом исследования?

В опросе участвовали 400 студентов бакалавриата

и 129 магистрантов МГИМО. Выборка репрезентативна: при

ее разработке использовался квотный принцип отбора респондентов,

учитывались такие факторы как принадлежность к факультету, курсу обучения,

а также пол. Изначально мы хотели сравнить наших студентов

со студентами других ведущих университетов Москвы.

Один из акцентов исследования — проблема безопасности в сети. Что понималось вами под безопасностью в интернете?

Безопасность очень многогранна. Применительно к интернету можно, например, говорить о безопасности социокультурной, правовой, психологической и безопасности для здоровья.

Даже безопасности для здоровья?

Именно так. Среднестатистическое время пребывания студента в интернете

в будний день — около четырех часов, а в выходные даже

больше. При этом значительная часть молодых людей проводит в интернете

более пяти часов. Например, в МГИМО таких 15,7%, в МГУ — 19,2%,

в РУДН — 26,5%. Более пяти часов в выходной день: МГИМО —

19,6%, МГУ — 23,2%, РУДН — 31,7%.

При этом значительная часть молодых людей проводит в интернете

более пяти часов. Например, в МГИМО таких 15,7%, в МГУ — 19,2%,

в РУДН — 26,5%. Более пяти часов в выходной день: МГИМО —

19,6%, МГУ — 23,2%, РУДН — 31,7%.

То есть, грубо говоря, каждый пятый студент проводит большую часть свободного времени, сидя за компьютером?

Не совсем. Дело в том, что время, проводимое в интернете за компьютером, сокращается, а время выхода в интернет с мобильного телефона резко увеличивается. Именно за счет этого фактора «набегает» столь большое общее время, проводимое в интернете. Вот что по этому поводу сказали сами студенты. Выход в интернет более одного раза в день с мобильного телефона: МГИМО — 69,1%, МГУ — 60,4%, РУДН — 63,9%. Выход в интернет более одного раза в день с компьютера: МГИМО — 20,8%, МГУ — 35,2%, РУДН — 20,5%.

В итоге время пребывания в сети составляет в среднем шестую

часть суток. Судите сами, насколько такая психологическая и эмоциональная

нагрузка опасна или безопасна для здоровья человека. На наш взгляд,

опасна, во всяком случае, это может быть отложенная во времени

опасность, подобная курению: естественно, реальной угрозы здоровью

на сегодняшний день нет, но она может дать о себе знать

в будущем.

На наш взгляд,

опасна, во всяком случае, это может быть отложенная во времени

опасность, подобная курению: естественно, реальной угрозы здоровью

на сегодняшний день нет, но она может дать о себе знать

в будущем.

И как этих угроз избежать? Есть ли у Вас рецепт?

Думается, возможные решения проблемы лежат в следующих плоскостях: поиск нужной информации можно осуществлять за счет альтернативных источников, в том числе, лучшего, более удобного для студентов функционирования библиотек, организации межвузовских семинаров и конференций и т. п. И не на последнем месте должно быть общение лицом к лицу, которое вытесняется интернет-общением. Да, наконец, просто нужна качественная социокультурная рекреация, на которую бы не жалко было потратить время!

Насколько сами респонденты разделяют Ваши опасения? Есть ли студенты, которые считают, что они проводят избыточно много времени в интернете?

Организованные нами фокус-группы показали, что ряд студентов осознает эти

опасности. Но нас главным образом интересовали, как я уже отметил,

проблемы безопасности, относящиеся к социальной, культурной

и правовой сферам.

Но нас главным образом интересовали, как я уже отметил,

проблемы безопасности, относящиеся к социальной, культурной

и правовой сферам.

Вероятно, конкретное наполнение этих проблем связано с тем, ради чего, собственно, студенты выходят в интернет.

Вы совершенно правы. Давайте посмотрим, что собственно привлекает студентов, какова собственно функциональность интернета.

Ведущая явная функция — использование сети для учебы и работы: МГИМО — 85,5%; МГУ — 88,3%; РУДН — 86,0%. Знакомство с новостями: МГИМО — 55,3%; МГУ — 38,8%; РУДН — 41,1%. (Данные превышают 100%, так как студенты могли выбрать несколько опций, функционально значимых для них).

Все это свидетельствует о том, что в контексте общей рационализации жизнедеятельности студентов интернет сокращает время поиска нужной информации, которое высвобождается для других видов деятельности.

Также нами была выявлена тенденция повышения эффективности использования

ресурсов интернета по мере того, как студенты переходят на более

старшие курсы обучения — в учебных и профессиональных целях

более активно используются те сервисы всемирной паутины, которые позволяют

решать профессионально-учебные задачи и меньше задействуются сайты,

предназначенные для развлечения.

Получается, что, вопреки расхожему мнению, интернет не отвлекает молодежь от учебы и работы, а ровно наоборот — студенты идут в сеть за знаниями?

Не все так просто, как может казаться на первый взгляд.

В сложном обществе нет явлений однозначно положительных или отрицательных.

Функциональность интернета амбивалентна: ряд студентов, на что зачастую

жалуются преподаватели, идет по легкому пути получения достаточно

ограниченных, «куцых» сведений по изучаемой проблеме вместо серьезной

проработки рекомендуемых первоисточников. Аналогично: довольствуются новостями

бегущей строки вместо чтения аналитических статей газет и журналов.

На наш взгляд, в этом состоят социокультурные опасности формирования

рассудочного, поверхностного подхода к знанию вообще

в противоположность разумного, глубокого подхода. Это не только

личностная, но и социальная проблема. Упрощенческий подход

к сути сложных проблем сложного общества, в котором мы живем

(извините за тавтологию), зачастую оборачивается тем, что «хотим, как

лучше, получается же — как всегда».

Для чего еще, кроме учебы и работы, используют интернет студенты? Какие потребности он удовлетворяет?

По данным нашего опроса, функция общения и знакомства стоит на втором месте: МГИМО — 59,9%; МГУ — 67,0%; РУДН — 64,5%.

Но, замечу, это весьма динамичная функция: чем меньше возраст студентов, тем больше их вовлеченность в социальные сети, тем выше коммуникативная активность в виртуальном пространстве. И наоборот: на старших курсах время, отводимое на эту функцию, сокращается.

На третьем месте идут развлечения и игры: МГИМО — 44,4%; МГУ — 40,8%; РУДН — 42,1%. Замечу, что в целом общение в собственно социальных сетях составило: МГИМО — 93,4%; МГУ — 92,2%; РУДН — 90,4%.

При сохранении настоящей тенденции использования студентами социальных сетей

Вконтакте, Facebook и Twitter, количество первокурсников, которые выберут

социальные сети в качестве средства общения в 2013 году, составит

99,03%, а еще через год каждый первокурсник будет участником всемирной

коммуникационной паутины.

Социальные сети тоже несут в себе какие-то угрозы?

Да, разумеется. У виртуального общения есть и латентная сторона: сокращается взаимодействие лицом к лицу, уменьшаются социальные практики коллективистского толка. «Друзья» в интернете как легко заводятся, так и легко оставляются, они радикально отличаются от реальных друзей, предполагающих устойчивые человеческие связи, крепкую дружбу, серьезные интимные отношения в виде любви. Многие социологи отмечают, что возникла принципиально новая проблема: перенос отношений к виртуальным «друзьям» на друзей реальных. Известный британский социолог Зигмунд Бауман считает, что эта опасность вообще представляет угрозу собственно человеческой коммуникации. В изданной в прошлом году книге «Побочный ущерб» ученый утверждает, что если не так давно «побочные потери» относились лишь к военной сфере, то ныне они пришли в повседневную социальную жизнь, что связано с «ослаблением и закатом буквально всех межчеловеческих уз».

Но, несмотря на все эти мрачные «побочные последствия», люди

все больше вовлекаются в общение в социальных сетях. В чем

секрет?

В чем

секрет?

В доступности сетевого общения. На это качество интернета, кстати, указало подавляющее большинство студентов всех университетов: МГИМО — 64,8%; МГУ — 72,8%; РУДН — 52,8%.

Многие студенты воспринимают сеть Интернет как пространство неограниченной свободы в силу его «бестелесности» (можно не видеть своего партнера по общению), анонимности (можно скрываться под вымышленным именем или ником), легкости установления/разрыва контакта с пользователями, находящимися в любой точке мирового пространства. Такое восприятие интернета порождает иллюзию безопасности сетевого общения.

А что сами студенты считают наиболее привлекательными чертами интернет-общения?

Открытость. К достоинствам открытости интернета студенты отнесли возможность общаться с гражданами других стран: МГИМО — 58,7%; МГУ — 40,8%; РУДН — 52,8%.

Достоинством студенты считают также анонимность. Впрочем, количество

студентов, ценящих эту возможность, невелико: МГИМО — 5,6%; МГУ —

6,8%; РУДН — 9,4%. На наш взгляд, эти данные свидетельствуют

о том, что у студентов в принципе нет стремления

к анонимному общению. Им нет смысла себя как-то скрывать.

На наш взгляд, эти данные свидетельствуют

о том, что у студентов в принципе нет стремления

к анонимному общению. Им нет смысла себя как-то скрывать.

К достоинствам открытости сети Интернет студенты отнесли также возможность быстрого доступа к информации о том, что происходит в мире. Вот данные чтения новостных лент: МГИМО — 91,7%; МГУ — 91,1%; РУДН — 91,8%.

Далее, студентов привлекает возможность выступить организаторами виртуальных сообществ, что студенты реально делают: МГИМО — 22, 1%; МГУ — 21,1%; РУДН — 21,4%.

Отмечается также возможность участия в социальных акциях и флешмобах: МГИМО — 27,8%; МГУ — 35,0%; РУДН — 23,2%.

Многие студенты сами ведут блоги: МГИМО — 21,0%; МГУ — 11,7%; РУДН — 17,3%.

Особо отмечу, что многие студенты подписаны в блогах политических деятелей: МГИМО — 34,4%; МГУ — 26,2%; РУДН — 30,0%.

Эти данные опровергают распространенное мнение об увеличивающейся

аполитичности молодежи. Да, представители молодежи не спешат вступить

в ту или иную политическую партию. Однако молодые люди достаточно

активно участвуют в новых формах политической жизни.

Однако молодые люди достаточно

активно участвуют в новых формах политической жизни.

А что чаще всего вызывает у студентов негативные эмоции при общении в интернете?

Наибольшее раздражение вызывают, что характерно, те явления, которые являются оборотной стороной той же открытости. Среди них:

недобросовестный маркетинг и спам —

МГИМО — 51,9%; МГУ — 44,7%; РУДН — 53,6%;непристойные выражения и непристойный контент —

МГИМО — 30,2%; МГУ — 27,7%; РУДН — 35,1%;пропаганда насилия и безответственного поведения —

МГИМО — 21,7%; МГУ — 19,1%; РУДН — 20,6%;оскорбление и клевета в адрес других —

МГИМО — 20,1%; МГУ — 22,3%; РУДН — 21,6%;политическое давление и пропаганда —

МГИМО — 16,6%; МГУ — 14,9%; РУДН — 27,8%;оскорбление и клевета в собственный адрес —

МГИМО — 20,3%; МГУ — 16,0%; РУДН — 20,6%.Реалии интернета как сложной самоорганизующейся социальной сети таковы, что

достоинства открытости и свободы интернета, увы, сочетаются

с «побочными потерями». С одной стороны, имеет место миксофилия

(стремление к многообразию жизнедеятельности, знакомству с новыми

ценностями и т. д.), а с другой — формируется миксофобия

(страх перед увеличивающимся многообразием стилей жизни и опасностей).

С одной стороны, имеет место миксофилия

(стремление к многообразию жизнедеятельности, знакомству с новыми

ценностями и т. д.), а с другой — формируется миксофобия

(страх перед увеличивающимся многообразием стилей жизни и опасностей).

Вероятно, это раздражение и этот страх и стали причиной ряда общественных и законодательных инициатив, направленных на усиление регулирующих функций государства в области интернет-коммуникаций? Как Вы считаете, удастся ли соблюсти баланс между свободой и безопасностью?

Безопасность, свобода и открытость в силу своей сложной природы

не могут противопоставляться друг другу. Что же касается той части

вопроса о «рецепте» баланса между ними, то, по моему мнению,

необходимо разрабатывать стратегию управляемой открытости, которая должна

прийти на смену самоорганизованной открытости. Речь, конечно,

не о том, чтобы управление вытеснило самоорганизацию (это невозможно

по определению), а о нахождении оптимального баланса между

управлением и самоорганизацией.

А как Вы относитесь к формированию «черных списков» сайтов и блокированию доступа к определенному контенту?

Я не могу сказать, насколько это технически возможно. Да и проблема эта не столько техническая, сколько формирующейся космополитической этики интернета, а также ее адекватности мировым и национальным правовым нормам. Сегодня вряд ли кто-то может предложить готовые рецепты. Во всяком случае, мне о них неизвестно. Но наше исследование выявило то, как студенты к этим проблемам относятся.

Будет интересно узнать их мнение.

Студенты неплохо осведомлены, что существует ответственность перед законом за свое поведение в интернете: МГИМО — 50,5%; МГУ — 45,6%; РУДН — 55,1%.

Более того, подавляющее большинство студентов хотят, чтобы была ответственность перед законом: МГИМО — 55,6%; МГУ — 62,7%; РУДН — 65,4%.

Однако что меня порадовало, так это то, что подавляющее большинство

студентов ведущих вузов России вообще не предрасположено к неэтичному

поведению в сети. В качестве достоинства отсутствие строгих моральных

норм и обязательств готовы рассматривать лишь немногие респонденты:

МГИМО — 6,8%; МГУ — 1,9%; РУДН — 9,4%.

В качестве достоинства отсутствие строгих моральных

норм и обязательств готовы рассматривать лишь немногие респонденты:

МГИМО — 6,8%; МГУ — 1,9%; РУДН — 9,4%.

Любопытно, что отношение юношей и девушек к этой проблеме весьма не единодушно. Оказалось, что юноши менее чувствительны к соблюдению этических норм поведения другими пользователями в виртуальном пространстве. Среди них больше тех, кто не осудил бы своих друзей за недостоверную информацию (16,2% против 7,6% девушек) и меньше сторонников публичного осуждения недобросовестных пользователей интернета (46,0% против 52,3%).

И еще один интересный результат, который мы получили. Студенты,

имеющие, по их оценкам, высокий уровень социальной адаптации

и ответственности за свое поведение в сети, не являются

сторонниками введения административно-правовых ограничительных способов

регуляции поведения в интернете, они чаще называют в качестве условий

формирования ответственного поведения — воспитание, уважение к другим

людям, чувство долга.

Студенты, в основном из других регионов, боящиеся быть непонятыми, старающиеся не раскрывать себя полностью в виртуальном общении, — за необходимость принятия законодательных норм регуляции поведения в сети.

А что Вы сами думаете по этому поводу?

Идет становление очень сложной реальности. Появились принципиально новые проблемы, которые еще ждут своих исследователей. В усложняющемся социуме этика коммуникации перестает основываться только на моральных нормах, которые в разных культурах становятся «текучими». В этих условиях этика, предполагающая правовые нормы, становится необходимым условием безопасности и эффективности любого общения.

Точка зрения авторов, комментарии которых публикуются в рубрике

«Говорят эксперты МГИМО», может не совпадать с мнением редакции портала.

Коммерческое использование данной информации запрещено.

При перепечатке ссылка на Портал МГИМО обязательна.

Екатерина Мизулина о недостоверной информации в интернете — Газета.Ru

close

100%

Depositphotos, коллаж

Один мой знакомый опубликовал видео процесса своей вакцинации в одной популярной соцсети. Он забыл об этом, так как не пользуется постоянно этой социальной сетью, а открыв свой аккаунт через два месяца, с удивлением обнаружил сотни тысяч просмотров, тысячи комментариев, среди которых множество фейков.

Почему так происходит? Кто и зачем распространяет фейки? Как отличить фейк от экспертного мнения? Что делать, если вы натолкнулись на фейк и возмущены?

Давайте разберемся во всем подробно.

Волонтеры Лиги безопасного интернета и Национального центра помощи детям уже больше года мониторят распространение фейковой информации в сети. С 1 июня этого года они обнаружили 4706 фейков о коронавирусе, вакцине, ходе вакцинации, ограничительных мерах. Некоторые откровенно постановочные недостоверные сообщения, распространяемые под видом достоверных, были направлены в МВД России для проведения проверки. В последние две недели число таких фейков резко возросло: ежедневно волонтеры находят от 100 до 150 недостоверных новостей.

С 1 июня этого года они обнаружили 4706 фейков о коронавирусе, вакцине, ходе вакцинации, ограничительных мерах. Некоторые откровенно постановочные недостоверные сообщения, распространяемые под видом достоверных, были направлены в МВД России для проведения проверки. В последние две недели число таких фейков резко возросло: ежедневно волонтеры находят от 100 до 150 недостоверных новостей.

Что за фейки распространяются и как они выглядят?

Видео, которое увидели тысячи пользователей пару недель назад: мужчина едет за рулем и якобы везет медсестру больницы, которая почему-то весь ролик находится за кадром. Тревожным голосом взволнованная женщина рассказывает о том, что к ним «в отделение постоянно едут молодые и взрослые граждане умирать после вакцинации». Никаких фактов, подробностей: только страшное сообщение, которое массово стало пересылаться россиянами в мессенджере WhatsApp.

Еще один пугающий рассказ. Теперь уже из TikTok: прямое включение, срочный репортаж, просьба массово распространить информацию. Женщина скрывает свое лицо, и, показывая городской пейзаж, рассказывает жуткую историю: якобы «ВОЗ запретила вакцину «Спутник V», а нашим гражданам колют запрещенный препарат». Начинаем проверять информацию. Действительно, проверка ВОЗ приезжала на один из российских заводов, где производят вакцину, и нашла там нарушения… в области экологического контроля и недостаточное соблюдение норм безопасности сотрудниками. Результаты инспекции ВОЗ не ставят под сомнение качество вакцины «Спутник V», заверили, в свою очередь, в российском Минпромторге. Зачем тогда вводить людей в заблуждение?

Женщина скрывает свое лицо, и, показывая городской пейзаж, рассказывает жуткую историю: якобы «ВОЗ запретила вакцину «Спутник V», а нашим гражданам колют запрещенный препарат». Начинаем проверять информацию. Действительно, проверка ВОЗ приезжала на один из российских заводов, где производят вакцину, и нашла там нарушения… в области экологического контроля и недостаточное соблюдение норм безопасности сотрудниками. Результаты инспекции ВОЗ не ставят под сомнение качество вакцины «Спутник V», заверили, в свою очередь, в российском Минпромторге. Зачем тогда вводить людей в заблуждение?

Сегодня, готовя этот материал, изучала публикации за последние сутки. Среди сотен разных роликов впечатлил один: якобы «от вакцинации умирают только полицейские». Ну, конечно, а кто же еще? Ведь именно их работа – привлекать к ответственности вот таких «фантазеров». Никаких фактов, естественно, автор видео не приводит.

Кто и зачем распространяет фейки?

Условно мы выделяем три категории тех, кто это делает.

Первая категория – те, кто услышал новость, например, в метро или автобусе, и поспешил сообщить об этом своим подписчикам (и всему миру). Чаще всего это непроверенная информация о том, что произошло или может произойти в том или ином регионе, городе.

Вторая – это те, кто услышал или придумал информацию и распространил ее для того, чтобы повысить охваты своего аккаунта, увеличить число подписчиков и попасть в рекомендации той или иной соцсети. Это хайп на непроверенной информации. Нередко к такому способу прибегают и отдельные СМИ. Конечно, когда к авторам приходит полиция, они «сожалеют» и говорят о том, что опубликовали информацию по ошибке. Но итоговая цель этих граждан – монетизация.

Самая опасная категория среди тех, кто распространяет фейки, – это профессиональные провокаторы. Они действуют как изнутри России, так и из-за рубежа. Они создают такие фейки по определенным шаблонам, монтируют видео или подменяют голос, создают некий эффект «реальности», например, детскими голосами на фоне. А главное – быстро распространяют фейки с использованием определенных технологий продвижения в соцсетях. Публикации таких провокаторов могут за пару часов охватить один регион, а за 1-2 дня – всю страну. Начинается все через WhatsApp, потом как вирус охватывает все соцсети, а дальше появляются даже листовки в подъездах.

А главное – быстро распространяют фейки с использованием определенных технологий продвижения в соцсетях. Публикации таких провокаторов могут за пару часов охватить один регион, а за 1-2 дня – всю страну. Начинается все через WhatsApp, потом как вирус охватывает все соцсети, а дальше появляются даже листовки в подъездах.

Интересный прецедент был установлен и участником Лиги безопасного интернета – компанией «Крибрум» в прошлом году: после объявления президента России о старте процесса по обсуждению поправок в Конституцию было зарегистрировано множество новых аккаунтов-пустышек в соцсетях, которые сначала в марте 2020 года распространяли фейки о содержании поправок, потом после объявления режима самоизоляции – о ковиде, а после назначения даты общероссийского голосования по поправкам в Конституцию опять вернулись к распространению фейков по вопросу содержания поправок и ходе голосования.

В чем цель распространения фейков?

Кроме случаев хайпа и желания прославиться, у профессиональных провокаторов основная цель одна – посеять панику, создать хаос, а тем значит — дестабилизировать ситуацию в отдельном городе, регионе или во всей стране.

Информацию, которую люди получают через мессенджер, многие воспринимают на веру, очень лично. Ведь это прислал тот, кого вы знаете и кому можете доверять.

Что происходит в итоге? Коллапс. Люди начинают массово звонить в учреждения, органы власти, узнавать информацию. Так, например, произошло в прошлом году, когда родственники тех, кто находится в местах лишения свободы, массово устремились в колонии: фейк о распространении ковида в исправительных учреждения в разных форматах (с указанием того или иного учреждения) облетел всю страну.

Человеку со слабым здоровьем или пожилому человеку от такой информации вообще может стать плохо: такие случаи нередки в последнее время.

Еще один фактор – это коммерческие интересы. Производители иностранных вакцин заинтересованы в дискредитации отечественных препаратов, особенно на территории России. Это логично, ведь так их прибыль будет гораздо больше.

Какая ответственность существует?

Прошлой весной была введена административная и уголовная ответственность за распространение недостоверной информации под видом достоверной. Такая ответственность введена и для физических лиц, и для средств массовой информации.

Такая ответственность введена и для физических лиц, и для средств массовой информации.

Как отличить фейк? Что должно насторожить?

У каждой недостоверной публикации, распространяемой под видом достоверной, есть «тревожные звоночки», которые должны насторожить. Чаще всего такое сообщение вам переслали. Автор видео или текста остается анонимным или указывается вымышленная отсылка на автора информации, которую невозможно проверить, например «сестра работает в больнице», «сообщили в полиции», «сообщили со скорой».

Всегда идет просьба о массовом репосте или же, наоборот, говорится о том, что это секретная информация, которую «скрывают власти» и ее нужно держать в тайне (кто же из нас эту тайну не перешлет всем друзьям?). Подчеркивается, что значимая для общества информация специально утаивается.

Информация всегда подается в очень эмоциональном и тревожном ключе. Часто в аудиофайлах на фоне слышны голоса женщин и маленьких детей, разговоры: это приближает фейк к реальной жизни. В таких в аудио и видео файлах, если прислушаться и присмотреться, видна склейка: наложение звука или видеокадров.

В таких в аудио и видео файлах, если прислушаться и присмотреться, видна склейка: наложение звука или видеокадров.

В фейках часто речь идет о многочисленных жертвах и угрозе жизни и здоровью большого числа людей.

А самое главное – сообщение не содержит факты, которые можно перепроверить. Открыв поисковик или страницы СМИ, вы не найдете абсолютно ничего.

Почему вообще появляются фейки?

Фейки появляются потому, что существует информационный вакуум по той или иной теме. У людей отсутствует достаточная информация, нет активного диалога с гражданами, разъяснительной работы со стороны органов власти и департаментов здравоохранения. Люди не видят четкой информации от врачей, научных деятелей и начинают сами искать и анализировать информацию. Так начинают плодиться слухи, домыслы, активизироваться «диванные эксперты». В эту среду и приходят профессиональные «фейкометы» и начинают распространять ложную информацию.

Мы призываем все уровни власти к диалогу с гражданами и информационной открытости. Чем больше будет живого общения, разъяснений, терпения у чиновников, тем меньше будет появляться непроверенной информации.

Чем больше будет живого общения, разъяснений, терпения у чиновников, тем меньше будет появляться непроверенной информации.

На каких площадках и в каких пабликах чаще всего можно встретить фейки?

По-прежнему лидер по распространению фейков – это WhatsApp. Несмотря на все меры, которые ввела платформа были, в том числе по ограничению количества пересылаемых сообщений, по маркировке пересылаемых сообщений, многие фейки, в частности, скачанные из других соцсетей, продолжают там активно пересылаться.

В ряде регионов в этом преуспевает и другой мессенджер – Viber. Также мы видим колоссальный рост числа фейков в TikTok, в различных группах и чатах в Telegram, множество видео на YouTube, в пабликах «ВКонтакте», в Instagram, Facebook.

Чаще всего такие фейки сначала появляются в каких-то группах и сообществах: группы заводчиков домашних животных, чаты групп детского сада, группы родителей школьников, сообщества автомобилистов и так далее. То есть группы, где собираются активные граждане и общаются на те или иные темы. В последнее время мы видим также всплеск создания сообществ по теме вакцинации и ковида в целом, там тоже активно гуляют фейки. А потом уже из этих чатов сообщения пересылаются друг другу.

В последнее время мы видим также всплеск создания сообществ по теме вакцинации и ковида в целом, там тоже активно гуляют фейки. А потом уже из этих чатов сообщения пересылаются друг другу.

Как пожаловаться на фейк?

В любой социальной сети или мессенджере есть возможность пожаловаться на распространение недостоверной информации. Ваша жалоба должна быть рассмотрена платформой в течение 3 суток, а если соцсеть вам не ответит, то в соответствии с законом «о самоцензуре соцсетей» вы имеете право обратиться в Роскомнадзор.

Каждый раз, когда наш волонтер находит фейк, он сначала проверяет его и, убедившись, что распространяется недостоверная информация, направляет жалобу в мессенджер или соцсеть.

За год работы в ходе мониторинга фейков мы видим, что пока соцсети очень вяло реагируют на эти жалобы: только 13% фейков удаляют или маркируют соцсети, остальное продолжает быть доступным пользователям. TikTok нам то и дело предлагает «заблокировать не понравившегося пользователя», а Telegram в 99% случаев вообще не отвечает на жалобы, даже если они направлены на английском языке.

Что делать с проблемой распространения фейков?

Многие страны сейчас пытаются решить этот вопрос. Например, интересным путем пошел Сингапур: он законодательно обязал соцсети маркировать информацию как фейк в случае, если такое предписание выдал уполномоченный орган власти. Так, в соответствии с POFMA (Protection from Online Falsehoods and Manipulation Act, закон, вступивший в силу в Сингапуре в 2019 году) уполномоченный орган власти может потребовать от соцсети откорректировать фейк, добавив к нему справочную информацию, содержащую факты и ссылку на достоверную информацию по этой теме. В отдельных случаях власти страны вправе потребовать от соцсети разослать уведомление всем пользователям, которые просматривали недостоверную публикацию на территории Сингапура. Этим правом власти страны с октября 2019 года до сентября 2020 года воспользовались лишь в 11 случаях, а корректировки к публикациям вносили 51 раз. Жители государства считают такой вариант более гуманным: по их мнению, он не ограничивает право на свободу передачи информации в отличие от полной блокировки публикации.

Может быть, и для России такой вариант был бы выходом: ведь угнаться в такой лавине информации за каждым автором фейка физически невозможно. А для пользователя всегда будет предупреждение: эта информация недостоверна и может быть опасной.

Украинские социальные сети наводнены заведомо ложной и недостоверной информацией о COVID-19

В течение девяти месяцев – с марта по ноябрь 2020 года, используя новейшие инструменты мониторинга и анализа, группа экспертов компании «SemanticForce» по заказу ООН проанализировала в социальных сетях и в украинских онлайн СМИ более 30 миллионов сообщений, связанных с тематикой COVID-19. В результате было выявлено 250 тысяч сообщений дезинформационного характера – от конспирологических теорий о происхождении вируса до откровенно ложной информации относительно прививок, методов лечения и профилактики инфекции.

В ходе исследования было установлено, что вся эта дезинформация негативно влияет на поведение людей, в частности их готовность придерживаться необходимых мер предосторожности – носить маски, соблюдать физическую дистанцию и т. д. Многие сообщения направлены на подрыв доверия населения к вакцинам. Такая «инфодемия», по мнению авторов доклада, чревата ростом уровня заболеваемости COVID-19.

д. Многие сообщения направлены на подрыв доверия населения к вакцинам. Такая «инфодемия», по мнению авторов доклада, чревата ростом уровня заболеваемости COVID-19.

В обнаруженныхфейковых постах в соцсетях и публикациях используются разного рода манипуляционные приемы, в них подается нередко заведомо ложная информация. Во многих материалах читателям навязывают конспирологические теории о происхождении вируса, или пытаются их убедить в том, что никакого вируса нет вообще.

По словам Постоянного представителя ПРООН на Украине Дафины Ґерчевой, исследование показало, что «инфодемия» – это реальная угроза здоровью жителей Украины. Она считает, что для борьбы с ней правительству важно объединить силы с общественными организациями, в частности с теми, которые выявляют фейковые публикации, а также с людьми, пользующимися популярностью в социальных медиа.

Герчева предупредила, что конспирологические теории, сплетни и злонамеренная дезинформация могут быстрее, чем вирус, распространяться в социальных сетях, особенно в условиях низкого уровня доверия к государственным институтам.

«В процессе нашего исследования было установлено, что, объединяя усилия правительства, СМИ, общественных лидеров и других надежных источников, можно стимулировать распространение достоверной информации о COVID-19 и преодолевать опасность дезинформации», – заявила представитель ООН.

В рамках исследования параллельно с мониторингом социальных медиа было опрошено 1000 украинцев по поводу того, что они знают о пандемии. Примерно треть из них считают, что у них низкие шансы заразиться новым коронавирусом. В ходе этого опроса было установлено, что основными источниками информации для граждан Украины являются социальные медиа. Об этом сказали 42 процента опрошенных. Для 26 процентов главный источник информации – телевидение. Но при этом большинство украинцев отмечали, что не всегда доверяют тому, что слышат и читают, а полагаются, в основном, на информацию от медиков.

Глава представительства ЮНИСЕФ на Украине Лотта Сильвандер отметила, что вероятность появления недостоверной информации в настоящее время как никогда высока. «Инфодемия» чревата ростом недоверия к вакцинации, может усложнить внедрение новых вакцин и подорвать доверие общественности к системе здравоохранения в целом», – сказала Сильвандер.

«Инфодемия» чревата ростом недоверия к вакцинации, может усложнить внедрение новых вакцин и подорвать доверие общественности к системе здравоохранения в целом», – сказала Сильвандер.

В выводах исследования содержится целый ряд рекомендаций для правительства, СМИ, социальных и медийных платформ в том, что касается борьбы с «инфодемией». Правительству рекомендовано создать единый центр по вопросам COVID-19 для координации работы на этом направлении. Среди прочего авторы исследования предлагают использовать популярные среди украинцев юмористические передачи для высмеивания дезинформации и ложных сообщений.

«Соглашайся или удали». Что нужно знать о новой политике конфиденциальности WhatsApp

Компания WhatsApp обновила свое пользовательское соглашение еще в начале года, заставив многих усомниться, что их личные данные будут по-прежнему надежно защищены. У клиентов мессенджера было несколько месяцев, чтобы принять его новые условия. Те, кто так и не сделал это в отведенный срок, теперь столкнутся с ограничениями работы сервиса, а в дальнейшем и с приостановкой аккаунта в WhatsApp.

15 мая истекает крайний срок, до которого пользователи WhatsApp должны согласиться с новой политикой конфиденциальности месседжера. Компания обновила пользовательское соглашение в январе 2021 года, прописав в нем пункт об обмене информацией с Facebook — материнской компанией сервиса. В январской версии документа появился новый раздел — «Данные о транзакциях и платежах» в разделе «Предоставляемая вами информация», которого не было в предыдущей версии соглашения от 20 июля 2020 года. В разделе «Услуги третьих лиц» WhatsApp также добавил описание сотрудничества с Facebook, рассказав об интеграции с другими продуктами компании.

«Мы позволяем вам использовать наши сервисы в сочетании с сервисами третьих лиц и другими продуктами компании Facebook. Если вы используете наши услуги с такими сторонними сервисами или продуктами Facebook, мы можем получать от них информацию о вас», — говорится в документе.

При этом, как отметили в Роскомнадзоре, мессенджер еще с 2014 года передает значительный объем пользовательских данных компании Facebook.

Одновременно в WhatsApp указывают, что делятся с Facebook далеко не всей информацией, особенно если речь идет о частных разговорах или переписках, которые защищены сквозным шифрованием. Касаемо новых правил, как уточняет мессенджер, они помогут клиентам общаться напрямую с бизнесом, видеть рекламу Facebook в разных сервисах компании и делать покупки в онлайн-магазинах на сервисах Facebook прямо в WhatsApp.

Изменения «затрагивают необязательные функции для компаний и являются частью общей программы, направленной на обеспечение более удобного, простого и защищенного общения с бизнес-аккаунтами», сообщается в блоге WhatsApp. Что именно под этим подразумевается, до конца непонятно. По сути, из этих слов следует, что новые правила будут касаться только взаимодействий пользователей с компаниями и именно эти данные могут быть переданы Facebook или Instagram (которая также принадлежит соцсети).

Изменения после 15 мая

Изначально руководство WhatsApp установило дедлайн для принятия нового соглашения до 8 февраля, но возмущение пользователей в СМИ и соцсетях вынудило мессенджер перенести сроки на несколько месяцев, чтобы разъяснить правила своей политики.

В самой компании заявили, что в Сети распространилось множество недостоверной информации о том, что Facebook якобы сможет читать переписки пользователей и будет отслеживать их передвижение, что не является правдой. Одна из основных претензий касалась расширения обмена данными между WhatsApp и Facebook. Однако во внешней пресс-службе соцсети в ответ на запрос ТАСС это опровергли: «Обновление не расширяет возможности WhatsApp по обмену данными с Facebook».

Чтобы прояснить ситуацию, в WhatsApp выпустили новую страницу FAQ на своем сайте, где рассказывается о приватном общении в приложении.

«Изменения касаются выборочных бизнес-функций в WhatsApp и обеспечивают дополнительную прозрачность в отношении того, как мы собираем и используем данные», — говорится в сообщении.

Те, кто не согласился с новым пользовательским соглашением WhatsApp до 15 мая, сможет и дальше использовать мессенджер, но в ограниченном режиме.

При этом клиенты не смогут открывать списки чатов, но продолжат получать аудио и видеозвонки. Также компания сохранит возможность нажимать на всплывающие уведомления, чтобы читать сообщения, отвечать на них или перезванивать. Однако через несколько недель ограниченной функциональности пользователей лишат возможности получать входящие звонки и уведомления.

Также компания сохранит возможность нажимать на всплывающие уведомления, чтобы читать сообщения, отвечать на них или перезванивать. Однако через несколько недель ограниченной функциональности пользователей лишат возможности получать входящие звонки и уведомления.

Таким образом принятие новых правил ставит клиентов мессенджера перед выбором: продолжить пользоваться WhatsApp и принять соглашение либо искать альтернативные мессенджеры. Стоит отметить, что WhatsApp обычно удаляет неактивные учетные записи через 120 дней.

Недружественный подход

Как сообщило агентство Bloomberg, в ответ на политику WhatsApp уполномоченный Гамбурга по защите персональных данных и свободе информации Йоханнес Каспар временно запретил мессенджеру собирать данные пользователей. Он также обратился к другим регуляторам ЕС с призывом принять аналогичные меры во всех 27 странах сообщества. По его словам, новые условия WhatsApp, разрешающие сбор данных, незаконны, поскольку они непрозрачны, непоследовательны и чрезмерно широки. В самом Facebook отметили, что Каспар неверно оценил цели компании и реальные причины обновления пользовательского соглашения.

В самом Facebook отметили, что Каспар неверно оценил цели компании и реальные причины обновления пользовательского соглашения.

«Решение направлено на защиту прав и свобод миллионов пользователей, которые соглашаются с условиями по всей Германии, — приводит Bloomberg заявление Каспара. — Нам необходимо предотвратить ущерб и недостатки, связанные с этой теневой процедурой».

Еще в начале года новость о новых правилах WhatsApp возмутила и другие правительства. К примеру, Совет по вопросам конкуренции Турции инициировал расследование в отношении Facebook из-за изменений пользовательского соглашения.

«Совет по вопросам конкуренции начал собственное расследование в отношении Facebook и WhatsApp, а также приостановил необходимость совместного использования ими данных [пользователей социальной сети и мессенджера]», — указывается в коммюнике. На этом фоне сотрудники турецких госучреждений стали заводить аккаунты в Telegram и BIP — мессенджере, принадлежащем турецкой компании Turkcell.

О необходимости уходить с платформы WhatsApp заговорили и в России. В Роскомнадзоре российских пользователей WhatsApp предупредили о недостаточной защите персональных данных в этом мессенджере.

Ранее первый зампредседателя комиссии Общественной палаты РФ по развитию информационного сообщества, СМИ и массовых коммуникаций Александр Малькевич отмечал, что «российским чиновникам следует перестать общаться в WhatsApp по рабочим вопросам».

Малькевич призвал задуматься о том, что «вся наша конфиденциальная информация теперь на законных правах будет становиться достоянием западных спецслужб».

«Неоптимальным» новый подход мессенджера назвал и член комитета Госдумы по информационной политике, информационным технологиям и связи Антон Горелкин.

«Они просто поставили своих пользователей перед фактом: соглашайся на наши условия или удали приложение. Это недружественная политика по отношению к пользователю, и, полагаю, она будет постепенно снижать популярность WhatsApp», — прогнозирует депутат.

Signal к переходу

После первых новостей о новых правилах WhatsApp основатель SpaceX, а с недавних пор и самый богатый человек на планете Илон Маск призвал своих подписчиков в Twitter переносить общение в Signal. Этот сервис для мгновенного обмена сообщениями часто используют журналисты, активисты, политики и все те, кто особенно озабочен сетевой безопасностью.

Signal не принадлежит большой корпорации, а работает в рамках фонда Signal Foundation, который спонсируют частные лица. Мессенджер является одним из эталонов шифрования, его протоколами защиты пользуются в том числе WhatsApp и Skype. В отличие от остальных приложений Signal не собирает данные клиентов для рекламных целей, так как не пытается монетизировать свою аудиторию.

Мессенджер начал набирать популярность в разгар американских протестов против убийства Джорджа Флойда. Участники этих акций опасались, что IT-компании могут делиться их персональными данными с полицией. Единственное, что требует Signal при регистрации нового пользователя, — это номер телефона, но компания уже работает над тем, чтобы обойти и это правило.

После твита Илона Маска мессенджер столкнулся с массовым наплывом новых клиентов, что даже привело к его техническим сбоям.

«Отправка кодов верификации в настоящее время задерживается у нескольких провайдеров, так как слишком много людей пытаются присоединиться к Signal», — написала компания в своем Twitter-аккаунте.

Доверие пользователей

Помимо Signal число скачиваний резко возросло и у Telegram. Основатель мессенджера Павел Дуров напрямую связал это с новой политикой WhatsApp.

По словам предпринимателя, его компания не намерена собирать данные своих пользователей или масштабно внедрять рекламу. Дуров также рассказал, что в Facebook работает целый отдел, который изучает успех его приложения.

«Я счастлив сэкономить Facebook десятки миллионов долларов и бесплатно раскрыть наш секрет: уважайте своих пользователей», — отметил он.

По информации аналитической компании Sensor Tower, в период с 6 по 8 января более 100 тыс. пользователей установили Signal в Apple Store и Google Play, в то время как Telegram за это же время скачали почти 2,2 млн раз.

«Signal и Telegram — теперь лучшие альтернативы, если вы беспокоитесь о своей конфиденциальности», — написал в Twitter редактор TechCrunch Майк Бутчер.

По данным Sensor Tower, за первую неделю 2021 года число скачиваний WhatsApp упало на 11% по сравнению с предыдущей неделей, но все равно достигло почти 10,5 млн скачиваний по всему миру. В марте 2020 года суммарная аудитория WhatsApp достигла 2 млрд человек. Одновременно представитель мессенджера заверил ТАСС, что в последние несколько месяцев «большинство людей» приняли обновленные правила, а «WhatsApp продолжает расти».

Дмитрий Беляев, Ирина Ли

Ложная информация как угроза обществу: эксперты поддержали законопроект о фейках | Российское агентство правовой и судебной информации

Контекст

РАПСИ, 13 дек — РАПСИ. Распространение заведомо ложной информации может привести к дестабилизации общества, поэтому введение ответственности за такие действия абсолютно оправдано и необходимо, считают эксперты, опрошенные РАПСИ.

«Я поддерживаю данный законопроект, поскольку в сложившихся политико-экономических условиях распространение заведомо недостоверной резонансной информации под видом достоверной может представлять общественную опасность и повлечь негативные последствия, в том числе и массовые беспорядки, дезорганизацию деятельности органов государственной власти, нормальной работы систем жизнеобеспечения», — считает советник Федеральной палаты адвокатов РФ Нвер Гаспарян.

Адвокат Алена Адлер также придерживается мнения о том, что введение ответственности за распространение фейковых сообщений необходимо, так как подобные действия могут дестабилизировать обстановку в стране и нанести вред неопределенному кругу лиц. По ее мнению, подтверждение или опровержение достоверности информации не должно вызывать вопросов. «Сложность с доказыванием мотивов, на мой взгляд, это чисто технический вопрос, и не думаю, что это будет являться какой-то невыполнимой задачей. Все-таки для наступления ответственности нужно будет установить сам факт наличия вины, поэтому я считаю, нет опасений того, что малейшая критика будет восприниматься как оскорбление или неуважение. У нас же есть ответственность за призыв к терроризму — соответственно, по аналогии можно будет применять будущую норму и по поводу сообщения фейковых новостей», — пояснила Адлер.

Во многих западноевропейских странах уже поняли, что информация из нетрадиционных источников (например, из соцсетей) может представлять серьезную угрозу социальной или государственной безопасности, напомнил адвокат Алексей Михальчик. Он добавил, что аналогичным образом на Западе законодательно защищаются и символы государства. «Другое дело, что у меня, как у практикующего адвоката, вызывает серьезные опасение то, как будет формироваться правоприменительная практика. Не используют ли правоохранительные органы эти законы для нарушения таких базовых прав, как свобода слова и свобода от цензуры?» — резюмировал Михальчик.

Накануне в Госдуму внесли законопроект, который вводит административную ответственность за распространение в интернете материалов, оскорбляющих Конституцию и государство.

Авторами документа стали председатель Комитета Совета Федерации по конституционному законодательству Андрей Клишас, сенатор Людмила Бокова и депутат Дмитрий Вяткин. Они предлагают дополнить статью «мелкое хулиганство», указав ответственность за распространение в сети материалов, «в неприличной форме выражающих явное неуважение» к обществу, государству, официальным государственным символам, Конституции и органам власти.

Кроме того, в Госдуму внесен законопроект о штрафах за распространение в СМИ и интернете заведомо недостоверной информации под видом правдивых сообщений, создающей угрозу здоровью граждан и массового нарушения общественного порядка.

«Власти скрывают страшные вещи». Как бороться с фейками… | «Вечёрка» Санкт-Петербург

В марте вступили в силу новые поправки в Федеральный Закон «Об информации, информационных технологиях и о защите информации». Так называемый «Закон о фейках» был принят еще в 2019 году. Как он функционирует сегодня, и как обезопасить себя от недостоверной информации в Интернете, разбиралась корреспондент «Вечёрки» Александра Савина.

Кто такие «фейки» и откуда они берутся?

Практически каждый пользователей соцсетей получал сообщение от друзей или родственников: «Моя тетя/дядя/брат работает в органах и там готовится операция…» или «Секретный способ выздороветь от лучшего врача мира… Информация секретная, поделитесь с родственниками, чтобы они узнали правду».

Это и есть классический пример фейка. Но откуда они появляются и почему?

«Фейком» в законодательстве обозначается недостоверная информация, которая провоцирует панику, создает угрозу причинения вреда жизни и здоровью граждан, имуществу, массовых нарушений общественного порядка и общественной безопасности.

Поводом для появления фейков служит любое резонансное событие – катастрофа, природный катаклизм, болезнь, политические изменения. Умыслы их создателей кроются в дестабилизации общества или государства, во введении в заблуждение, создании искусственного спроса на товары, обогащения путём мошенничества или созданием волны хайпа вокруг какой-то персоны.

Для распространения недостоверных новостей использует мессенджеры и соцсети. Иногда, чтобы выдать фейк за правду, создаются сайты несуществующих СМИ, так информация выглядит солиднее и её могут заметить новостные агрегаторы.

Зачем и почему приняли закон?

Толчком для закрепления в законодательстве понятия «фейк» и наказания за его распространения, стала трагедия в ТЦ «Зимняя вишня» в 2018 году.

Напомним, что 25 марта 2018 года в Кемерово в результате пожара торгового центра погибли 60 человек, в том числе 37 детей. После случившегося в сети распространилась информация, что погибли триста человек.

Украинский блоггер Евгений Вольнов был одним из создателей фейков. Под видом «майора МЧС Позднякова» он обзванивал больницы и морги, и сообщал ложную информацию о погибших. Дезинформация вокруг «Зимней вишне» запустили волну паники, позднее в отношении блоггера в России возбудили уголовное дело по статье 282 УК РФ — «возбуждение ненависти и вражды».

На момент случившегося, ограничить распространение фейков могли только площадки, на которых публиковались сообщения. Но из-за масштабов информации, интернет-ресурсы не успевали мониторить и блокировать ложный контент.

Через год после трагедии в Кемерово, Дума приняла пакет законов по контролю и ограничению распространения недостоверной информации. Выявляет фейки Генеральная прокуратура, а отслеживанием удаления и блокировкой ресурсов занимается Роскомнадзор.

За создание и публичное распространение фейков грозит наказание в виде штрафа. При этом штрафы различаются по тяжести вызванных последствий, которые наступили в результате распространения дезинформации.

Резонный вопрос

Во время подготовки материала, «Вечёрка» провела опрос о знании закона среди жителей Петербурга. В опросе поучаствовало 20 человек и большинство из них о законе слышали впервые.

Часто задаваемые вопросы жителей, мы обсудили с адвокатом Тимуром Харди:

Можно ли попасть под статью за репост фейка, с публичной страницы в социальных сетях на свой личный профиль?

Да, конечно. Репост — осознанное действие и вас могут привлечь, если вы распространили заведомо ложную информацию, которая может ввести людей в заблуждение и нанести вред.

Если на моей странице будет написан фейк 10-летней давности, стоит ли мне опасаться?

Нет, вам опасаться нечего. Уголовная ответственность возможна только за те деяния, которые совершены после вступления закона в силу. Нельзя наказать за действия, которые совершили до этого, пусть даже общественно опасные последствия наступили после. Однако, я рекомендую хорошенько проверить свои страницы, если у вас есть какие-то сомнительные посты, я советую их удалить, либо написать комментарий, что не согласны с содержанием и высказать свое мнение.

Как обезопасить себя от фейков?

Сверяйте информацию с той, что по этой теме публикуют СМИ, которым вы доверяете. Не плодите фейки и не рассылайте непроверенную информацию, даже в WatsApp своим близким. Не верьте жёлтой прессе, которая для привлечения читателей публикует провокационные заголовки.

Как распознать фейк?

Обычно фейки написаны очень эмоциональным языком и неизвестно кем. Особенно их много было с началом пандемии, когда в WatsApp постоянно пересылали фейковые страшилки. В которых по великому секрету родственница мужа соседки, свекровь, которой работает в больнице, сообщает – что «мы все умрём и надо срочно закупаться продуктами».

Все это очень грустно, и такие безобидные, на первый взгляд сообщения могут посеять большую панику.

Поэтому, не верьте непроверенной информации и не распространяйте ее. Обычно в ней речь о том, что власти от нас скрывают «страшные вещи», в сообщениях всегда присутствует призыв к какому-то действию и информация о том, что жизни людей что-то угрожает.

И, в первую очередь, подумайте, откуда информация? Если в сообщении говорится, например, что Минздрав к чему-то призывает, зайдите на сайт Минздрава. Есть там информация о которой говорится в сообщении? Нет? Значит фейк.

Есть ли возможность самому, попытаться остановить распространение фейка?

Приведу один пример, на днях в сети распространили фейк, касающийся призыва, верней НЕ призыва, в армию представителей двух народов. Мне начали писать с просьбой высказать своё мнение как адвоката.

Естественно, как правовед я обязан был выяснить не фейк ли это. У меня на это ушло полчаса.

Это был фейк, естественно, я не стал его распространять. Но посчитал своим долгом написать пост в соцсетях, и в нем я опроверг эту информацию, которую уже многие с возмущением распространили.

Мои подписчики, которые со мной много лет, знают, что я не стану публиковать непроверенную информацию и доверяют мне. Знаю, что после моего поста многие удалили этот фейк.

«Утка» или простая ложь, выдаваемая за правду в социальных сетях, опасна воздействием на общество.

Критическое отношение и информационная грамотность важные навыки для борьбы с недостоверной информацией. Получая и распространяя информацию, лучше потратить пару минут на её проверку, чем выйти за рамки закона.

Александра Савина

Влияние неточной информации о здоровье в Интернете в учебной среде средней школы

Фон: Пациенты в США обычно используют Интернет для получения медицинской информации. Хотя в Интернете можно найти значительный объем информации, связанной со здоровьем, точность этой информации сильно различается.

Цели: Целью исследования было определить, насколько эффективно студенты могут оценивать точность Интернет-материалов при сборе информации по спорной медицинской теме с помощью простого поиска по ключевым словам.

Методы: Группа из 34 студентов из средней школы научного магнита в Хьюстоне, штат Техас, искала термины «безопасность вакцины» и «опасность вакцины» с помощью Google, а затем ответила на вопросы относительно точности информации о здоровье на возвращенных сайтах. Студентов также попросили описать уроки, которые они извлекли из упражнения, и ответить на вопросы относительно силы доказательств семи утверждений о вакцинации.Из-за неожиданного открытия, что большинство студентов покинули упражнение с неточной информацией относительно безопасности и эффективности вакцин, эти же студенты участвовали в последующем исследовании, в котором был показан основанный на фактах видеоролик с вакциной, после которого была проведена оценка вакцины. студенческие знания были повторены.

Полученные результаты: Из 34 участников 20 (59%) сочли, что Интернет-сайты в целом точны, хотя более половины ссылок (22 из 40, 55%), которые просматривали студенты, на самом деле были неточными в целом. .Высокий процент студентов покинул первое упражнение со значительными неправильными представлениями о вакцинах; 18 из 34 участников (53%) сообщили о неточных заявлениях о вакцинах в извлеченных ими уроках. Из 41 поддающегося проверке факта о вакцинах, которые сообщили участники в своих заявлениях об извлеченных уроках, 24 факта (59%) были неверными. После презентации фильма большинство учеников вышли из упражнения с правильной информацией о вакцинах, основанной на их утверждении об извлеченных уроках.В этом случае 29 из 31 участника (94%) сообщили точную информацию о вакцинах. Из 49 достоверных фактов о вакцинах, которые сообщили участники, только 2 (4%) были неверными. Студенты также получили более высокие правильные баллы в упражнении «сила доказательств» после просмотра видео.

Выводы: К разрешению студентам использовать Интернет для получения информации на медицинские темы следует подходить с осторожностью, поскольку студенты могут забрать преимущественно неверную информацию.Важно дополнить противоречивую информацию твердым, недвусмысленным сообщением, которое передает те уроки, которые преподаватель считает наиболее важными. Это заключительное сообщение должно быть основано на фактах, но, возможно, оно должно содержать анекдотический компонент, чтобы противостоять сильному эмоциональному посланию, которое часто доставляется неточными интернет-сайтами.

Опасности дезинформации (фейковые новости) | Элли Бантинг

Фото Элайджа О’Доннелла на UnsplashВ наши дни термин «фейковые новости» стал популярным.Президент Трамп использует этот термин всякий раз, когда ему не нравится что-то, опубликованное в основных средствах массовой информации. Расследование выборов 2016 года доказало, что дезинформация, дезинформация и фейковые новости сыграли важную роль в этих выборах. Хотя это было четыре года назад, количество дезинформации, распространяемой в Интернете, продолжает оставаться проблемой. В то время, когда мир страдает от серьезного кризиса в области здравоохранения, не время игнорировать проблемы, которые вызывают дезинформация и дезинформация.Прокручивая ленту новостей на Facebook, можно найти множество примеров информации, которая либо ложна, либо неверно истолкована. Когда эта информация связана с бушующей пандемией, жизненно важно, чтобы читатели могли отличить факты от вымысла. Тот факт, что что-то публикуется в Интернете, не означает, что информация является законной.

Дезинформация вызвана фермой троллей, структурой социальных сетей и человеческой природой. Последствия дезинформации опасны, потому что эти кампании отвлекают людей от других важных вопросов, они вызывают конфликты и подрывают демократию.Решение проблемы дезинформации — сложная задача, которую должны решать СМИ, технологические компании и правительство.

Следующее видео дает хороший обзор фейковых новостей и их распространения.

Термин «фейковые новости» стал обычным явлением, когда человек слышит новости, которым не хочет верить. Хотя медиаэксперты изначально определяли фейковые новости как «фактически ложную информацию, предоставленную в контексте якобы правдивой новости, которая преднамеренно предназначена для обмана читателей или зрителей», сегодня этот термин также включает кампании дезинформации, распространяемые через Интернет и в социальных сетях. («Фейковые новости в социальных сетях»).

Прежде чем перейти к обсуждению причин появления фейковых новостей, важно понять разницу между m isinformation и дезинформацией. Валери Штраус, пишущая для Washington Post , заявляет, что Dictionary.com определяет дезинформацию как «ложную информацию, которая распространяется независимо от того, есть ли намерение ввести в заблуждение». С другой стороны, «дезинформация» имеет совсем другое значение: «дезинформация» означает «преднамеренно вводящую в заблуждение или предвзятую информацию; манипулированный рассказ или факты; пропаганда »(Штраус).Подводя итог различию, зрители должны смотреть на намерение.

Например, если человек распространяет дезинформацию, он, скорее всего, верит, что это правда. Однако дезинформация создается и распространяется намеренно с целью ввести других в заблуждение. Различия между этими двумя терминами могут сбивать с толку, поскольку дезинформация может легко превратиться в дезинформацию, в зависимости от того, кто делится информацией и почему. Например, если политик намеренно распространяет ложную информацию, это дезинформация.Однако, если человек видит эту информацию, считает ее правдой, а затем делится ею с друзьями, это дезинформация.

Важно различать дезинформацию и дезинформацию.Когда люди распространяют дезинформацию, они часто верят информации, которой они делятся. Напротив, дезинформация создается и распространяется с намерением ввести других в заблуждение. Еще больше сбивает с толку тот факт, что дезинформация в конечном итоге может стать дезинформацией.Все зависит от того, кто этим поделился и почему. Например, если политик стратегически распространяет заведомо ложную информацию в форме статей, фотографий, мемов и т. Д., Это дезинформация. Когда человек видит эту дезинформацию, верит ей, а затем делится ею, это дезинформация.

Хотя идея фейковых новостей или дезинформации не нова, проблема становится все более и более распространенной с ростом популярности Интернета и социальных сетей. Многие факторы способствуют росту дезинформации и дезинформации, включая фермы троллей, структуру социальных сетей и человеческую природу.

Причина № 1 — Фермы троллейНа фото ниже показана ферма троллей в действии.

Одна из причин, по которой дезинформация распространяется так быстро сегодня, заключается в том, что поисковые машины в Интернете и сайты социальных сетей стали мишенями организованных групп, которые создают и распространяют дезинформацию в Интернете. Эти группы, известные как «фермы троллей», существуют во многих странах, но особенно в России.

Например, в Агентстве интернет-исследований, которое базируется в Ольгино, Россия, работало около 200–300 человек.В результате связанная с Кремлем ферма троллей, согласно отчету специального советника Роберта Мюллера (qtd в Snider), достигла 126 миллионов американцев в Facebook во время последних президентских выборов с помощью мошеннических аккаунтов, групп и рекламы.

Эти «фермы троллей» генерируют онлайн-трафик, направленный на влияние на общественное мнение и распространение дезинформации и дезинформации. Россияне были отправлены в Соединенные Штаты для создания инфраструктуры, которая позволила этим фермам создавать учетные записи в социальных сетях, которые выглядели так, как будто они родом из Америки и принадлежали американцам.

Клинт Уоттс, старший научный сотрудник Исследовательского института внешней политики, утверждает, что цель этих ферм троллей — «создать раскол, натравливающий американцев друг на друга. Они создают эти конфликты и открыто сообщают о них в спонсируемых государством российских СМИ о том, насколько нестабильна Америка. Цель — подорвать демократию. Итак, вы хотите, чтобы Америка выглядела нестабильной, а американцы не доверяли друг другу (Qtd. В Snider) ».

Причина № 2 — Социальные сети Фото Уильяма Ивена на Unsplash — Facebook известен распространением фейковых новостейКак показало расследование Роберта Мюллера, фермы троллей эффективно использовали политическую напряженность в Соединенных Штатах для распространения дезинформации в социальных сетях, таких как как Facebook и Twitter.Публикация конкретных, вызывающих разногласия и противоречивых тем вызывает разногласия среди зрителей. Это создает поляризацию, которая упрощает манипулирование зрителями. Алгоритмы, используемые для создания этого контента, могут использоваться фермами троллей. Используя алгоритмы, сайты социальных сетей могут изолировать зрителей от противоположных точек зрения, поэтому у них никогда не будет возможности увидеть другую сторону проблемы. Это называется «эффектом эхо-камеры», поскольку зрители, которые видят только одно мнение, начинают верить, что его мнение является доминирующим политическим, даже если оно не соответствует действительности.

Еще одна проблема, связанная с социальными сетями и дезинформацией, — это споры о том, являются ли сайты социальных сетей, такие как Facebook, издателями или платформами. Если эти сайты считаются издателями, они могут нести юридическую ответственность за контент, публикуемый их зрителями. Если они являются просто платформами, они не несут ответственности за любой контент, опубликованный на их сайте. Facebook позиционирует себя как «платформу» для общественности. Однако в судебном процессе считает себя «издателем». На этот вопрос необходимо ответить, чтобы контролировать распространение фейковых новостей в социальных сетях.

Причина № 3: Человеческая природаНа приведенном ниже графике показано, как дезинформация и дезинформация имеют тенденцию пересекаться.

Последняя причина, по которой дезинформация и дезинформация распространяются так быстро, сводится к человеческой природе. Например, недавнее исследование дезинформации показало, что люди склонны делиться дезинформацией на 70 процентов чаще, чем фактической информацией (Соруш). Исследование, проведенное группой ученых из Массачусетского технологического института, опубликованное в журнале Science, , показало, что «ложь распространилась значительно дальше, быстрее, глубже и шире, чем истина, во всех категориях информации, и эффекты были более выражены для ложные политические новости, чем ложные новости о терроризме, стихийных бедствиях, науке, городских легендах или финансовой информации »(Соруш).В этом отчете также было обнаружено, что для того, чтобы истина достигла 1500 человек, потребовалось в шесть раз больше времени, чем для распространения ложного утверждения. Что еще более удивительно, исследователи обнаружили, что эти ложные факты не распространялись ботами. Их распространяли обычные люди.

Понимание терминологии и некоторых причин, по которым дезинформация и дезинформация так быстро распространяются в социальных сетях, является первым шагом в решении проблемы. Последствия кампаний по дезинформации опасны, как будет показано в следующем разделе этого отчета.

В этом видео рассказывается, как фейковые новости и дезинформация меняют способ получения новостей.

Десять лет назад Facebook был платформой, которая способствовала распространению демократии по всему миру. Google делал доступ к информации проще, чем когда-либо, а блоггеры и репортеры социальных сетей поощряли протесты в странах от Ирана до Туниса. Однако к 2017 году стало ясно, что роль Интернета не в улучшении демократии. В частности, платформы социальных сетей, которые помогли побудить людей к протестам в 2011 году, наносили ущерб демократии, распространяя дезинформацию, дезинформацию и пропаганду.Повторяя «большую ложь», восприимчивых людей можно легко убедить принять опасные идеи.

Центр информационных технологий и общества Калифорнийского университета в Санта-Барбаре заявляет, что дезинформация опасна, потому что эти кампании отвлекают людей от других важных проблем, которые никогда не решаются, они усиливают социальный конфликт, чтобы «подорвать веру людей в демократический процесс и способность людей работать. вместе », и они« подрывают функционирование демократии во всем мире ».

Эффект №1: дезинформация разрушает и уводитКак поясняется в этом видео, фальшивые новости имеют серьезные последствия.

Во-первых, дезинформация и фейковые новости предназначены для того, чтобы разрушить американскую жизнь и отвлечь граждан от более важных вопросов. Эти кампании использовались для разжигания теорий заговора после крупных трагедий, таких как массовые расстрелы. Российские агенты и другие политические деятели скармливали фальшивые новости теоретикам заговора, обычно утверждая, что стрельба была организована фанатиками контроля над оружием. Люди делились этими сообщениями с другими в социальных сетях, хотя знали, что они не настоящие. Эти кампании были успешны в отвлечении американцев от реальных проблем безопасности оружия и более строгих законов о контроле над оружием, потому что люди ищут заговоры в каждой трагедии, и эти теории распространялись через платформы социальных сетей во многих событиях с массовыми жертвами, таких как взрыв в Бостонском марафоне. и резня в Сэнди-Хук.

Эффект №2 — дезинформация может усилить национальные конфликты Фото Элио Сантоса на Unsplash — Протесты часто возникают из-за фейковых новостей.Во-вторых, кампании дезинформации могут использовать фейковые новости для обострения национальных конфликтов в Соединенных Штатах. Политически мотивированные фейковые новости могут распространяться через иностранные правительства, американские политические группы и сторонников теории заговора. Хотя у каждой из этих групп могут быть разные мотивы, результат один: распространение фейковых новостей для усиления социальных конфликтов.Эти объявления нацелены на спорные вопросы, такие как раса, Black Lives Matter, контроль над огнестрельным оружием и иммиграция. Русские даже использовали мероприятия в Facebook для организации протестов и противодействия протестам по определенному вопросу, в результате чего американцы боролись друг с другом из-за спорных вопросов. Эти события были придуманы для того, чтобы люди «поверили им, явились и устроили проблемы» («Опасность»).

Эффект № 3 Дезинформация угрожает демократическому процессуЭто видео ясно показывает, как фейковые новости могут угрожать демократическому процессу.

Наконец, дезинформация угрожает демократическому процессу, что ясно продемонстрировали выборы 2016 года. Поскольку более 62% американцев получают новости из социальных сетей, чрезвычайно важно убедиться, что эти новости не являются фальшивыми (Шиффрин).

Например, Российское агентство интернет-исследований проделало замечательную работу по обострению социальных конфликтов во время выборов 2016 года. Эти российские фермы троллей намеренно распространяли фальшивые новости в пользу Дональда Трампа и дискредитировали Хиллари Клинтон.Использование платной рекламы в Facebook для распространения дезинформации настроило американцев друг против друга. Центр информационных технологий заявил, что «комитеты Конгресса США по разведке, ответственные за расследование фейковых новостей, опубликовали 3500 таких рекламных объявлений». Это ясно показывает, что это была хорошо спланированная кампания, которая повлияла на результаты выборов в США.

Фейковые новости подрывают доверие к реальным новостям и правительству. Последствия этого для демократии огромны.Шриффрин утверждает, что «демократия зиждется на образованном населении; это одна из причин, почему государственное образование так важно ». Чтобы американцы могли участвовать в демократии, они должны понимать суть проблемы. В противном случае их решения о голосовании могут быть произвольными или основанными на пропаганде или пособничестве. Шиффрин продолжает поддерживать ее доводы, заявляя: «Если дезинформация и кампании фальшивых новостей действительно мешают гражданам самообразовываться — или, что еще хуже, активно манипулировать гражданами, заставляя их поверить в ложную информацию, — тогда сами основы демократии окажутся под угрозой.«